„Maschine, übernehmen Sie!“

Mit Chatbots in den neuen Job

Die KI- und Video-Chatbots helfen immer häufiger auch bei der Auswahl des Personals (vgl. Finger 2021). Beschleunigt wird diese Tendenz durch die Corona-Pandemie, in der persönliche Kontakte möglichst reduziert werden sollen. Sogenannte Applicant Tracking Systems (ATS) übernehmen die Vorsortierung der Onlinebewerbungen. Diese Systeme werden geschult, indem sie eine große Anzahl erfolgter Bewerbungen des Unternehmens auswerten und daraus positive oder negative Bewertungen generieren. Ein Einsatz des Systems bei Amazon zeigte allerdings, dass sich Vorurteile aus der Vergangenheit in die Gegenwart übertragen: Die KI hat alte Bewerbungen ausgewertet, bei denen bevorzugt technikaffine Männer eingestellt wurden, und sie hat daraus den Schluss gezogen, dass Frauen für die Einstellung weniger geeignet sind (vgl. Wilke 2018). Immerhin ist das aufgefallen und wurde inzwischen korrigiert. Es ist jedoch ein Beispiel dafür, wie Vorurteile aus der alten Welt des Menschen in die neue Welt der KI übertragen werden.

Weitere Diskriminierungen sind wahrscheinlich. 2010 veröffentlichte das Institut zur Zukunft der Arbeit (IZA) die Studie Ethnische Diskriminierung auf dem deutschen Arbeitsmarkt: Ein Feldexperiment. Ergebnis: Menschen mit ausländisch klingenden Namen haben bei identischen Lebensläufen viel geringere Chancen, für ein persönliches Bewerbungsgespräch ausgewählt zu werden. In dem Studienexperiment war die Chance in größeren Unternehmen um 14 % geringer, bei kleineren Firmen sogar um 24 % (vgl. Bils 2010).

Vorurteile aus der alten Welt des Menschen [werden] in die neue Welt der KI übertragen.

Auch aus anderen Gründen, beispielsweise aufgrund ihrer Herkunft oder ihres nicht ganz stromlinienförmigen Lebenslaufs, könnten Menschen herausgefiltert werden. Ein weiteres Vorurteil der KI scheint daraus zu resultieren, dass die Maschinen mehrheitlich mit Daten weißer Menschen gefüttert werden, was dazu führt, dass sie Bewerber*innen mit anderer Hautfarbe oft nicht berücksichtigen (vgl. Lobe 2020).

Die „einfache Ausgabe“ der KI checkt, ob die formalen Voraussetzungen für den angestrebten Job vorhanden sind: Welche Schulen und Hochschulen wurden in welchen Studienfächern mit welchen Noten absolviert, welche speziellen Fähigkeiten und Hobbys werden angegeben, welche Fortbildungsmaßnahmen wurden wahrgenommen und welche Sprachkenntnisse sind vorhanden. Gerade bei großen, bekannten oder attraktiven Unternehmen, zum Beispiel im Medienbereich, bewerben sich viele Personen, obwohl sie die geforderten Voraussetzungen gar nicht erfüllen. Da ist die Auswahl durch die KI eine Hilfe, die niemandem schadet.

Auch die Grammatik, die Zeichensetzung und die Rechtschreibung in den Bewerbungsschreiben können von den Maschinen erkannt und bewertet werden. Eine Beurteilung der Gesamtpersönlichkeit, zu der beispielsweise Teamfähigkeit, gedankliche Flexibilität oder Zuverlässigkeit gehören, können die Trackingsysteme dagegen kaum anhand der Bewerbungsschreiben vornehmen.

In der nächsten Stufe können Bewerber*innen es mit einem Video-Chatbot zu tun bekommen. Er fragt zum Beispiel, warum ein Jobwechsel angestrebt wird oder warum sie sich für die angestrebte Stelle für geeignet halten und beurteilen so die Motivation. Die Chatbots analysieren sowohl Mimik, Kleidung und andere Accessoires wie Brille, Haarschnitt oder Kopftuch und bewerten das gemäß den vorgegebenen Algorithmen: Eine Brille weist dabei nicht auf Bildung oder Seriosität hin, sondern auf „geringere Ernsthaftigkeit“ (vgl. Bedford-Strohm/Miethge 2021).

Journalist*innen des Bayerischen Rundfunks und des Nachrichtenmagazins „Der Spiegel“ haben in einem Versuch hunderte Videos mit denselben elf Personen in unterschiedlicher Kleidung, mit veränderten Frisuren, mit und ohne Brille erstellt und damit die Video-Chatbots gefüttert (ebd.). Mit dem veränderten Outfit änderte sich jeweils auch die Bewertung derselben Person. Die KI ist also leicht zu irritieren. Ihr Ergebnis bewegt sich im Bereich des Zufalls, wenn die Veränderung einfacher Rahmenbedingungen die Einschätzung der Persönlichkeit grundlegend beeinflusst (vgl. Harlan et al. 2021).

Eine Brille weist dabei nicht auf Bildung oder Seriosität hin, sondern auf „geringere Ernsthaftigkeit“.

Sicher ist: Eine Personalabteilung kann durch den Einsatz der KI große Mengen an Bewerbungen relativ schnell und einfach auf die drei Personen reduzieren, mit denen ein persönliches Bewerbungsgespräch geführt werden soll. Die Frage ist nur: Wie zuverlässig sind solche Systeme und suchen sie tatsächlich auch die am besten geeigneten Kandidat*innen aus? Kann die Künstliche Intelligenz anhand der wenigen Daten, die sie bei einer virtuellen Vorstellungsrunde erhält, die Persönlichkeit der Bewerber*innen zutreffend erfassen? Und wie geht man mit Diskriminierungen und Ausgrenzungen um, wenn bestimmte Ethnien oder Gender ausgeschlossen oder bevorzugt werden, was wir in der analogen Welt gerade verändern wollen?

Erfolgreiche Bewerbung: meistens Glücksache

Fangen wir mit der Frage an, ob bei klassischen Bewerbungsgesprächen ein optimales Ergebnis herauskommt, und zwar für beide Seiten, für die Bewerber*innen und für die zukünftigen Arbeitgeber*innen. Bewerbungsgespräche, die von der Personalabteilung, manchmal auch mit Unterstützung aus der Fachabteilung, durchgeführt werden, sind im Ergebnis oft Glückssache. Egal, ob standardisierte Fragen gestellt werden oder ob man einfach drauflosplaudert und die Bewerber*innen in ein Gespräch verwickelt, um dabei zum Beispiel die Sozialkompetenz und das Fachwissen zu testen: Die Situation ist angespannt, und Kandidat*innen, die ihre Nervosität gut unterdrücken können, sind meistens im Vorteil. Ist der Redefluss zu schnell, wirkt die Person hektisch und flüchtig, bekommt sie kein Wort heraus, wird sie als ahnungslos, schüchtern und wenig begeisterungsfähig wahrgenommen.

Viele Attribute wie Gesichtszüge, Kleidung oder Geruch werden oft unbewusst wahrgenommen und schaffen Sympathie oder Antipathie, was schließlich die Entscheidung beeinflusst, ohne dass dies für die Qualität der zukünftigen Arbeit relevant wäre. Auch wenn man sich dessen nicht bewusst ist oder dies sogar bewusst unterdrücken will, spielt sicherlich auch die Attraktivität des Gegenübers eine Rolle. Nach Uwe Kanning, Professor für Wirtschaftspsychologie an der Hochschule Osnabrück und Experte für Bewerbungsverfahren, ist das Ergebnis von Bewerbungsgesprächen Glücksache: „… die stellen nachher Leute ein, bei denen sie sich gut fühlen, und merken gar nicht, dass sie systematischen Fehlern erlegen sind“ (zitiert nach Radü 2021). Oft basieren Entscheidungen auf subjektiven Kriterien, wenn die Bewertung der Fachkompetenz von Sympathie oder dem persönlichen Eindruck dominiert wird. „Objektivität beim Vorstellungsgespräch bedeutet nur, dass die Beurteilung des Bewerbers nicht abhängt von dem Menschen, der die Beurteilung vornimmt“, so Kanning.

Subjektive Aspekte reduzieren

So gesehen hat KI zumindest den Vorteil, dass ihre Algorithmen objektive Vergleiche herstellen und Sympathie, persönliche Vorlieben oder Abneigungen bei der Personalentscheidung keine Rolle spielen. Ihr ist die Person, die eingestellt werden soll, völlig egal, sie urteilt, indem sie die Antworten mit den definierten Erwartungen vergleicht und auswertet. Sie empfindet auch kein Mitleid gegenüber Menschen, die offensichtlich dringend eine Beschäftigung benötigen.

KI kann auf der einen Seite sehr viel, auf der anderen Seite aber auch sehr wenig: Sie erkennt beispielsweise Informationen nicht, die anders gestaltet oder in einer anderen Zeile zu finden sind, als das Programm es vorsieht. Außerdem operiert sie immer mit den Schlüsselbegriffen, die auch in der Ausschreibung vorkommen. Die Maschine liest also anders als ein Mensch, der weiß, welche Informationen normalerweise in einem Lebenslauf enthalten sind, und sie so lange sucht, bis er sie findet. Bewerber*innen, die wissen, wie die Maschinen ticken, verbessern ihre Chancen. Deshalb werden inzwischen entsprechende Schulungen angeboten.

Big Five

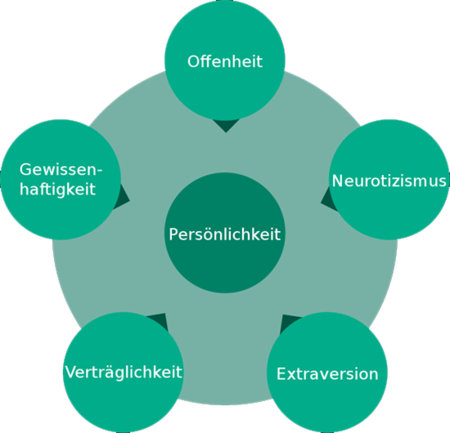

Bei fortgeschrittenen Chatbots wird die Bewertung der Persönlichkeit auf der Grundlage des psychologischen Modells der „Big Five“ vorgenommen, das Ernest Tupes und Raymond Christal auf der Grundlage von Arbeiten im amerikanischen Luftwaffen-Personallabor in den späten 1950er-Jahren entwickelten. 1990 formulierte J.M. Digman und 1993 erweiterte Lewis Goldman das Fünf-Faktor-Persönlichkeitsmodell: Offenheit, Gewissenhaftigkeit, Extroversion, Verträglichkeit und Neurotizismus (vgl. 123test.com o. J.).

Albin Schmitt - Eigenes Werk, CC BY-SA 4.0, Link

Das ist ein durchaus anerkanntes Modell, aber vermutlich wird sich niemand in einer Bewerbungssituation als verschlossen, wenig experimentierfreudig, unzuverlässig oder gar emotional labil darstellen. Jede*r hat wohl ein Gefühl dafür, wie man sich in einem Vorstellungsgespräch darstellen muss. Wer sich also gut auf die KI-Vorstellungsrunde vorbereitet, kann wahrscheinlich auch erfolgreich täuschen, während gut geschulte und erfahrene Personalberater*innen sich seltener etwas vormachen lassen. Allerdings ist auch bekannt, dass im realen Bewerbungsgespräch die Entscheidungen oft in den ersten Sekunden sehr spontan gefällt werden. Die Entscheidenden verfügen meistens über diverse Muster, Vorurteile und Vorlieben, die unbewusst zu einem Ergebnis führen, auch wenn sie selbst der Meinung sind, rationalen Überlegungen zu folgen (vgl. Bernieri 2000).1

Unterschiedliche Konzepte

Google hat eine Maschine entwickelt, die verspricht, Geschäftsbereiche und dazu passende Mitarbeiter*innen zusammenzubringen. IBM bietet eine Maschine an, die praktisch den gesamten Prozess vom Vorstellungsgespräch über die finale Entscheidung bis zum Arbeitsvertrag erledigt. Die Berliner Firma Viasto hat sich mit ihrem Angebot Interview Suite auf Bewerbungssoftware spezialisiert, die 10.000 modulare Fragen mit speziell auf das Unternehmen zugeschnittene verbindet. Durch die Rückkopplung der Erfahrungen mit den beteiligten Unternehmen kann das Programm ständig aktualisiert und verbessert werden (vgl. www.viasto.com). Das ist ein großer Vorteil gegenüber Personalentscheidungen durch Menschen, da beispielsweise Gespräche kaum genau replizierbar sind. Subjektive Einflüsse wie Tagesform, persönliches Wohlbefinden oder Unwohlsein, Müdigkeit nach vielen schon geführten Gesprächen machen es schwer, sich im Nachhinein an die einzelnen Kandidaten im Detail zu erinnern.2

Standards für Bewerbungs-KI

Inzwischen gibt es auch einige Regeln, die vom Deutschen Institut für Normung (DIN) formuliert wurden (vgl. DIN 2021). Sie umfassen im Wesentlichen drei Bereiche: Die Bewerber*innen müssen darüber informiert werden, welche Daten konkret über sie erhoben werden und welche Konsequenzen sich daraus ergeben können. Darüber hinaus darf sich die KI nicht auf Mimik oder Sprachmerkmale allein beziehen, es muss auch eine inhaltlich qualitative Bewertung vorgenommen werden. Außerdem muss das System den Qualitätsanforderungen der berufsbezogenen Eignungsdiagnostik entsprechen und darf keine Personengruppen systematisch vom Verfahren ausschließen.

Das klingt gut, ob das allerdings durchführbar und vor allem überprüfbar ist, bleibt abzuwarten. Denn auch in der üblichen Einstellungspraxis spielen subjektive Haltungen oft eine größere Rolle als die Einschätzung der tatsächlichen Eignung der Kandidat*innen. In allen Entscheidungsprozessen hat man es auch mit Blender*innen zu tun, deren größte Qualität darin besteht, sich selbst optimal zu vermarkten. Je anspruchsvoller die zu besetzende Stelle inhaltlich gestaltet ist, desto schwerer fällt es oft der Personalabteilung, tatsächliche fachliche Qualitäten in einem Bewerbungsgespräch herauszubekommen, weil das oft ihre eigenen Kenntnisse übersteigt. In solchen Fällen folgen die Personalverantwortlichen ihrem Gefühl, was je nach Erfahrung und Selbstreflexion durchaus erfolgversprechend sein kann – Objektivität gibt es also im Personalgespräch ebenso wenig wie in der Auswahl durch die KI.

Denn auch in der üblichen Einstellungspraxis spielen subjektive Haltungen oft eine größere Rolle als die Einschätzung der tatsächlichen Eignung der Kandidat*innen.

Natürlich hat auch jede*r Personalverantwortliche persönliche Empfindlichkeiten und Vorlieben, sodass beispielsweise jemand mit einem bestimmten Dialekt oder einer bestimmten Stimmhöhe bessere oder schlechtere Chancen haben kann. In diesem Zusammenhang spielt die Bewerbungslage auch eine große Rolle. Je größer die Auswahl ist, desto höher ist wahrscheinlich die Anzahl geeigneter Kandidat*innen, und deshalb haben diejenigen die größeren Chancen, die neben ihren beruflichen Qualitäten besonders attraktiv oder sympathisch wirken. Man könnte hier auch soziale Parameter mit einbeziehen und Menschen bevorzugen, die beispielsweise aufgrund ihrer familiären Situation dringend eine sichere Einnahmequelle brauchen. Das wäre auch subjektiv gefärbt, denn es hängt nicht mit der Qualifikation für den konkreten Arbeitsplatz zusammen. Aber es wäre auf jeden Fall menschlich.

Ausblick

Der Einsatz von KI in der Kommunikation lässt sich kaum aufhalten. Die KI wird vermutlich immer weiterentwickelt und in immer mehr Bereiche des menschlichen Lebens vordringen. Algorithmen erleichtern zum Beispiel im Fall von Streamingdiensten den Nutzer*innen die Auswahl. Wenn das Angebot jedoch auf falschen Annahmen basiert, wird es aufgrund unbrauchbarer Ergebnisse ignoriert, und die Annahmen müssen verbessert und angepasst werden. Auch wenn das Angebotene wenig Neues enthält, wird es wahrscheinlich abgelehnt. Der Mensch hat immer die Freiheit, sich zu entscheiden. Nach dem alten kommunikationswissenschaftlichen Ansatz „Nutzen und Belohnung“ wird er sich vom Algorithmus abwenden, wenn seiner Nutzung nicht mehr die gefühlte Belohnung folgt.

Ein mit einem Video-Chatbot geführtes Bewerbungsgespräch wird bei Bewerber*innen wahrscheinlich auf unterschiedliche Resonanz stoßen: Die einen fühlen sich gegenüber einer Maschine unbefangener, andere sind vielleicht verunsichert, keinen Menschen vor sich zu haben. Den Kandidat*innen wird aber letztlich nichts anderes übrig bleiben, als mit dem Automaten vorlieb zu nehmen, wenn sie den Job haben wollen. Sie werden also am wenigsten darüber mitentscheiden, ob sich dieser Trend verstärkt oder zurückbildet.

Für die Unternehmen liegt die Kostenersparnis auf der Hand, und sie werden an der KI festhalten, solange sie ihnen zumindest genauso gute und qualifizierte Mitarbeiter*innen beschert wie in der Vergangenheit das Auswahlverfahren durch die Personalabteilung. Und vermutlich wird die KI immer besser, je mehr Erfahrungen sie macht und je mehr Daten sie vergleichen kann.

Die ethische Frage ist eine andere. Die kann die KI von sich aus nicht lösen, sondern nur die Auftraggeber*innen bzw. die Programmierer*innen. Aber es wäre möglich, zum Beispiel Ausgrenzungen zu verhindern. Dass bei Amazon damals überwiegend Männer vorgeschlagen wurden, hätte den Personalverantwortlichen eigentlich selbst schnell auffallen müssen. Wenn man also als Unternehmen eine gerechte Verteilung zwischen Geschlechtern, Ethnien oder Altersgruppen haben möchte, muss man quantitative Ziele definieren und überprüfen, ob die Ergebnisse der KI damit übereinstimmen. Ist das nicht der Fall, muss nachjustiert werden. Ob die KI tatsächlich die besten Kandidat*innen findet, wird wahrscheinlich nicht so eine große Rolle spielen. Die Hauptsache wird sein, dass die Qualität des eingestellten Personals – und damit die Produktivität des Unternehmens – nicht erkennbar leidet.

Anmerkungen:

1) Unter www.123test.com können Interessierte ihr „Big-Five“-Profil testen.

2) Der Beitrag KI und Recruiting. Diese Fragen erwarten Sie im Bewerbungsgespräch (Radü 2021) bietet die Möglichkeit, eine reduzierte Version (1.000 statt 10.000 Fragen) des Fragenkatalogs zu durchlaufen. Welche Antworten es allerdings zu diesen Fragen geben würde, ist ebenso wenig bekannt wie die Menschen, die durch die KI mit welchem Erfolg ausgesucht wurden – es ist ja nur ein Test.

Quellen:

123test.com:Das Persönlichkeitsmodell der Big Five. In: 123test.com, o. J. Abrufbar unter: https://www.123test.com (letzter Zugriff: 19.08.2021)

Bedford-Strohm, L./Miethge, C.: Die Boss-Maschine: Wenn die KI zum Vorstellungsgespräch bittet. In: BR24, 01.03.2021. Abrufbar unter: https://www.br.de (letzter Zugriff: 19.08.2021)

Bernieri, F. J.: The importance of first impressions in a job interview, 01.05.2000. Abrufbar unter: https://www.researchgate.net (letzter Zugriff: 19.08.2021)

Bils, B.: Deutschland: Türkischer Name verringert Jobchancen. In: Bundeszentrale für politische Bildung, 01.02.2010. Abrufbar unter: https://www.bpb.de (letzter Zugriff: 19.08.2021)

DIN: DIN SPEC 91426. Qualitätsanforderungen für videobasierte Methoden der Personalauswahl. In: www.din.de, 12/2020. Abrufbar unter www.din.de (letzter Zugriff: 19.08.2021)

Finger, M.: Vorstellungsgespräch mit einer Maschine. In: Breitband, 20.03.2021. Abrufbar unter: https://www.deutschlandfunkkultur.de

Harlan, E/Köppen, U./Schnuck, O./Wreschniok, L.: Künstliche Intelligenz zur Persönlichkeitsanalyse fragwürdig, 16.02.2021. Abrufbar unter: https://www.br.de (letzter Zugriff: 19.08.2021)

Lobe, A.: Dekolonialisierung von Algorithmen. Programmierter Rassismus. In: taz, 01.09.2020. Abrufbar unter: https://taz.de (letzter Zugriff: 19.08.2021)

Radü, J.: KI und Recruiting. Diese Fragen erwarten Sie im Bewerbungsgespräch. In: Spiegel online, 08.03.2021. Abrufbar unter: https://www.spiegel.de (letzter Zugriff: 19.08.2021)

Wilke, F.: Bewerbungsroboter: Künstliche Intelligenz diskriminiert (noch). In: Zeit-online, 18.10.2018. Abrufbar unter: https://www.zeit.de (letzter Zugriff: 19.08.2021)